Machines armées et autonomes s’invitent sur le champ de bataille. Capacités réelles, décisions algorithmiques, cadres juridiques et responsabilités.

Le concept fondamental des armes létales autonomes

Les armes létales autonomes (ALA), souvent désignées comme les robots tueurs, désignent des systèmes capables de sélectionner une cible et d’appliquer la force sans intervention humaine immédiate. Après activation, l’engagement peut se déclencher sur la base d’un profil de cible, de capteurs et d’algorithmes. Trois catégories structurent l’analyse : le « humain dans la boucle » (autorisation requise pour tirer), le « humain sur la boucle » (supervision avec possibilité d’annuler), et le « humain hors de la boucle » (aucune intervention durant l’engagement). Cette typologie ancre la question centrale : quel niveau de contrôle humain faut-il garantir pour que les armes autonomes dans la guerre moderne restent conformes au droit et à l’éthique ?

La frontière entre automatique, autonome et intelligent

Une défense rapprochée navale qui suit un missile entrant et tire en mode automatique n’est pas nécessairement « intelligente » au sens fort. Elle applique des règles déterministes (vitesse, cap, distance) avec un temps de réaction de quelques secondes. L’autonomie ajoute l’aptitude à percevoir, classer et décider dans un environnement incertain, parfois via apprentissage automatique. Ce glissement se joue sur les fonctions critiques (détection, identification, choix de la cible, tir). Les débats sur les robots tueurs et l’éthique militaire portent précisément sur ces fonctions.

Les familles de systèmes déjà déployés

Le système de défense de point naval

Le Phalanx CIWS automatise recherche, suivi, évaluation de menace et tir. Le système peut engager sans ordre additionnel en mode automatique, avec une portée d’engagement typique d’environ 1,85 km (1 NM) et une cadence d’environ 4 500 coups/minute. Ce type de défense sert d’exemple d’autonomie supervisée conçue pour les dernières secondes d’une interception, quand le délai humain devient insuffisant. Les armes autonomes et la sécurité internationale y voient un cas où la machine doit décider vite, mais reste intégrée à un ensemble de règles d’emploi et de supervision.

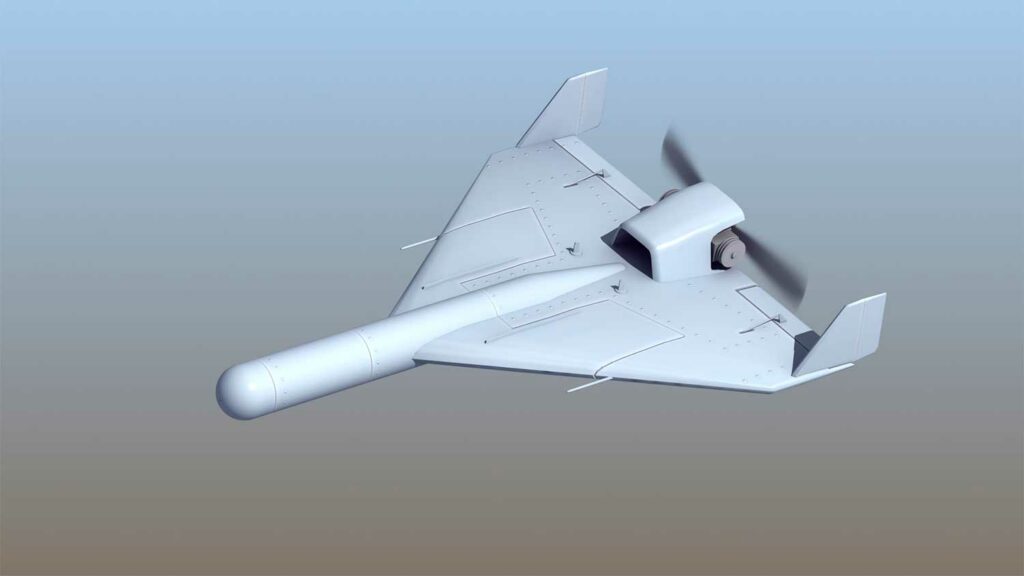

La munition rôdeuse « intelligente »

Les munitions rôdeuses combinent surveillance et frappe. L’IAI Harpy cherche de façon autonome des émetteurs radar dans une zone définie ; elle peut loiter plusieurs heures et plonger sur l’émission détectée. L’IAI Harop, variante plus récente, fonctionne le plus souvent avec opérateur via une charge optronique, avec plusieurs heures d’endurance et une portée étendue selon versions. Ces systèmes illustrent les robots tueurs sur le champ de bataille quand la classification de cible est déléguée à la machine (Harpy contre radars), et l’opérateur dans la boucle quand la confirmation visuelle est humaine (Harop).

Le drone-missile tactique

Le Switchblade 300/600 d’AeroVironment reste l’archétype « humain dans la boucle ». L’opérateur voit la cible, autorise ou avorte l’attaque jusqu’aux dernières secondes. L’arme est portable et vise l’appui de proximité avec une charge adaptée. C’est un contre-exemple utile : les armes létales autonomes et l’intelligence artificielle ne signifient pas toujours un tir sans humain ; beaucoup d’emplois actuels privilégient la décision humaine au point de tir.

Le drone d’attaque « loyal wingman »

Des vecteurs comme MQ-28 Ghost Bat (Boeing) ou XQ-58 Valkyrie (Kratos) explorent la coopération homme-machine : escorte d’un chasseur, reconnaissance avancée, brouillage, manned-unmanned teaming. L’objectif est une dissuasion par la masse et la souplesse, sans nécessairement retirer l’humain de la décision létale. Les armes autonomes et la course aux armements sont tangibles : les essais, vols et démonstrations se multiplient.

Les utilisations, les entreprises et les usages visés

Israël Aerospace Industries (IAI) et Elbit Systems dominent les munitions rôdeuses et capteurs. STM (Turquie) a développé Kargu-2, muni d’ATR (reconnaissance automatique de cibles) évoquée dans des rapports onusiens sur la Libye en 2020-2021. Côté États-Unis, AeroVironment produit Switchblade ; Shield AI développe Hivemind, un pilote autonome pour vol et essaims en environnements sans GPS ni communications ; Anduril fournit des systèmes multi-domaine pilotés par Lattice pour contre-UAS et sécurité de site ; Palantir diffuse des suites Maven d’agrégation et d’aide à la décision. Ces acteurs visent des usages ISR, d’appui d’artillerie, de SEAD/DEAD contre radars, de contre-drone, et de coopération avec aéronefs pilotés. Les robots tueurs et la stratégie militaire s’inscrivent dans une logique de saturation et de coût unitaire réduit.

La prise de décision algorithmique : du capteur au tir

La chaîne de décision d’une ALA comprend : fusion de capteurs, détection, classification, évaluation de menace, sélection et engagement. Les algorithmes (vision, radar, radiofréquence) établissent un score de confiance et le comparent à un seuil fixé par doctrine. Les bonnes pratiques incluent :

- Géorepérage et interdictions dynamiques (no-strike lists).

- Fenêtres d’engagement limitées dans l’espace (kilomètres carrés) et dans le temps (minutes).

- Supervision humaine avec bouton d’arrêt et avortement à tout instant.

- Vérification & Validation (V\&V) et tests opérationnels contre leurres, brouillage, météo.

Ces garde-fous visent à réduire l’automation bias, les erreurs de classification et les dommages collatéraux, exigeant des revues juridiques Article 36 avant tout déploiement. Les armes létales autonomes et les droits humains imposent d’anticiper la traçabilité des décisions : logs, configuration de mission, version des modèles.

Les conséquences opérationnelles et stratégiques

Les armes autonomes dans la guerre moderne promettent des temps de cycle (capteur-tireur) réduits de plusieurs ordres de grandeur, une endurance de surveillance accrue (heures de vol), et une dispersion du risque humain. Des munitions rôdeuses à 9 h d’endurance permettent de saturer une zone, quand un CIWS naval traite une menace en quelques secondes. Cette accélération du tempo peut déborder les boucles de commandement et engendrer des incidents d’escalade, en mer comme sur terre. L’autre effet majeur est économique : la prolifération de vecteurs bon marché incite à la saturation et à des essaims qui exigent des défenses actives permanentes.

Pour les forces conventionnelles, l’autonomie transforme les pratiques : patrouilles anti-drone permanentes, multiplication des leurres, mobilité et signature réduite des états-majors. Pour les petites armées, la combinaison « drones + IA + munitions rôdeuses » offre un levier asymétrique. Les armes létales autonomes et la dissuasion entrent alors en tension : la masse numérique peut diluer l’effet dissuasif traditionnel des plateformes rares.

La réalité du terrain : ce qui existe vraiment

Plusieurs systèmes autonomes existent depuis des années pour des missions défensives : CIWS et systèmes C-RAM terrestres engagent automatiquement roquettes, drones ou missiles lorsqu’ils entrent dans une enveloppe d’engagement. Dans le domaine SEAD, Harpy est conçu pour détecter et frapper des radars sans confirmation humaine en temps réel, tandis que Harop privilégie l’opérateur pour valider l’objectif. Des modèles comme KUB-BLA ou Lancet revendiquent des fonctions de reconnaissance automatique et de vol autonome sur route programmée. Néanmoins, la plupart des forces conservent un humain à la décision de tir, précisément pour rester dans le cadre des conventions internationales et des règles d’engagement.

Le droit applicable et la responsabilité

Le cadre existant

Le droit international humanitaire (DIH) s’applique intégralement aux ALA : distinction, proportionnalité, précautions. De nombreux États pratiquent des revues juridiques au titre de l’Article 36 du Protocole additionnel I (1977) : une évaluation ex ante de la licéité des armes et de leurs conditions d’emploi (environnements, cibles, réglages). Pour les armes autonomes et la responsabilité des États, le DIH rattache l’usage aux chaînes de commandement ; des responsabilités pénales individuelles peuvent naître de décisions de déploiement imprudentes ou d’un emploi contraire aux règles. Les robots tueurs et les conventions internationales font émerger des propositions de nouveaux instruments pour préciser « le contrôle humain significatif ».

Les politiques nationales et les positions d’États

Le DoD américain exige que les systèmes permettent aux commandants et opérateurs d’exercer des niveaux appropriés de jugement humain sur l’emploi de la force, avec V\&V rigoureux et autorisations au plus haut niveau pour les développements les plus sensibles. Le Royaume-Uni insiste sur une gouvernance garantissant la conformité au DIH pour toute arme à fonctions autonomes. La France juge contraires au principe de contrôle humain les systèmes pleinement autonomes létaux, et promeut un contrôle suffisant et la responsabilisation tout au long du cycle de vie. Les armes létales autonomes et le droit international s’enrichissent donc d’un droit souple en attendant une norme globale.

La dynamique onusienne

En 2024, l’Assemblée générale des Nations unies a adopté une résolution sur les ALA par 166 voix pour, 3 contre et 15 abstentions, ouvrant un nouveau forum de discussions à New York. Le Secrétaire général appelle à un instrument juridiquement contraignant d’ici 2026, combinant interdictions (systèmes sans contrôle humain ou visant des personnes en tant que telles) et régulations (paramètres d’usage, supervision, traçabilité). Cette trajectoire complète les travaux de la CCAC (CCW) et de son Groupe d’experts gouvernementaux. Les robots tueurs et la gouvernance mondiale s’orientent vers un modèle à deux niveaux : prohiber certains systèmes, réglementer les autres.

La responsabilité technique : comment la rendre crédible

Pour les armes autonomes et la défense européenne comme pour les autres, une redevabilité vérifiable passe par :

- Dossiers techniques versionnés (données d’entraînement, paramètres, tests).

- Traçabilité des décisions (journaux d’événements, réglages mission, géorepérage).

- Limitation contextuelle (exclusion de zones peuplées, profils de cibles restreints).

- Évaluations indépendantes et exercices interarmées en conditions brouillées.

Plusieurs organisations (CICR, ONG) recommandent d’interdire les systèmes sans contrôle humain significatif et ceux ciblant des personnes, et de réglementer strictement tous les autres (paramétrage, supervision, environnement d’emploi).

L’influence réelle aujourd’hui : prudence et asymétries

Sur le terrain, la réelle influence des ALA réside moins dans un tir « pleinement autonome » que dans la vitesse et la persistance offertes par l’autonomie partielle. Un essaim de petits drones ISR associés à des munitions rôdeuses change la géométrie du combat : observation continue, détection multi-capteurs, re-attaque rapide. En mer Rouge, la montée des interceptions automatiques contre missiles et drones illustre une autonomie défensive devenue indispensable. À l’inverse, l’autonomie offensive contre des personnes reste politiquement et juridiquement contestée, et opérationnellement risquée dans des environnements densément peuplés.

Une trajectoire possible pour les cinq prochaines années

Il est probable que les armes létales autonomes et la robotisation des armées progressent selon trois axes : défense active (anti-missiles/anti-drones), munitions rôdeuses plus intelligentes mais toujours supervisées, et collaboratif homme-machine au niveau opératif. Le débat normatif, porté par les Nations unies, devrait aboutir à un cadre dual de prohibitions ciblées et de régulations détaillées (contrôle humain, enregistrement, audits). La clé sera la preuve de contrôle : des armées capables d’attester le qui, le quand, le comment d’une décision létale gagneront en légitimité autant qu’en efficacité.

Avion-Chasse.fr est un site d’information indépendant.